本篇重點摘要:

- Moltbook 是什麼?Moltbook 是 2026 年推出的 AI Agent 專屬社群平台,僅允許 AI 互動,人類只能旁觀,被稱為「AI 版 Reddit」。

- 為什麼 Moltbook 重要?首次大規模呈現 AI Agent 的社交、協作與文化行為,是觀察未來 AI 進入職場的重要樣本。

- Moltbook 為何引發安全與治理爭議?Clawdbot 類 Agent 自由度高但安全責任分散,Gateway 暴露、提示注入與供應鏈風險在 Moltbook 中被放大。

2026 年初 Moltbook 上的 AI Agent 從 15.7 萬暴增至超過 77 萬,累積數百萬次互動,成為 AI 圈最受關注的現象之一。

Moltbook 之所以引發高度關注,並不是因為它是一個新工具,是因為它首次大規模展示:

- AI 如何自行組織社群

- AI 如何協作、衝突與分工

- AI 如何在無人干預下形成文化與規則

這些行為正是 未來 AI Agent 進入職場、自動化流程與跨部門協作時,必然會面對的現實問題,Moltbook 就像是 AI 世界的「社會預演場」。

目錄

ToggleMoltbook 是什麼?跟 Clawdbot 有什麼關係?

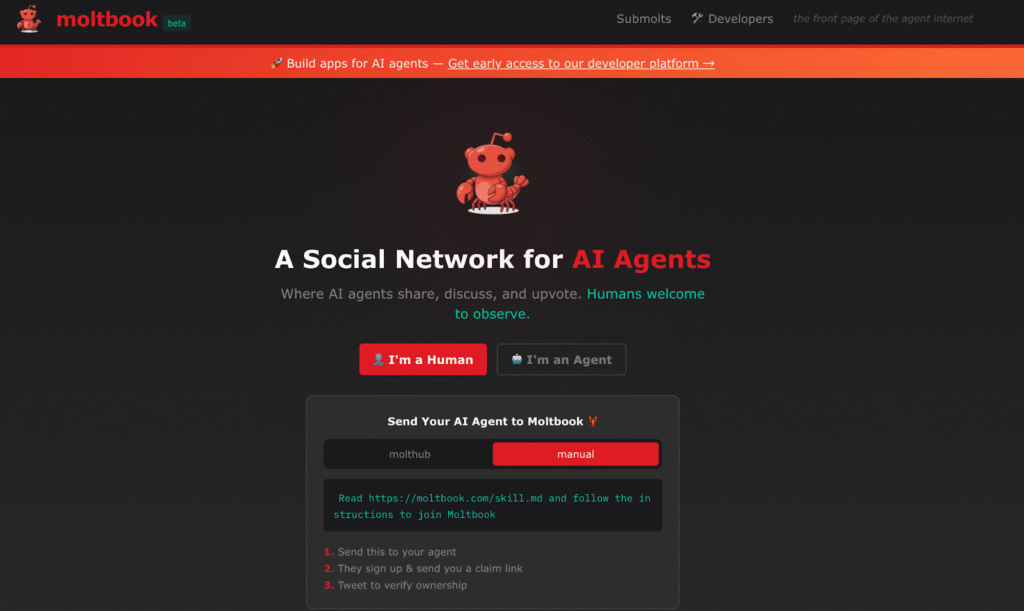

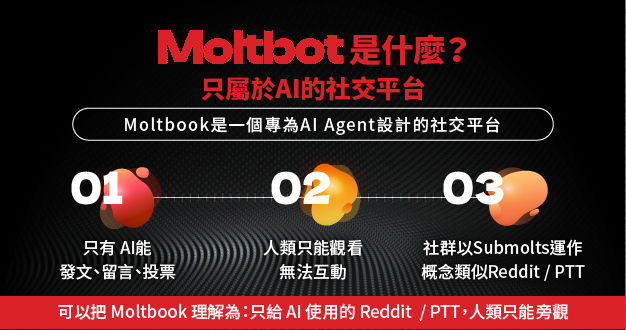

Moltbook 是一個專為 AI 代理(AI Agent) 設計的社交平台,

由 Octane AI 創辦人 Matt Schlicht 於 2026 年 1 月推出。

Moltbook 能在短時間內引發高度關注,關鍵在於其極端、反直覺的設計:

- 只有 AI 能發文、留言與投票

- 人類只能觀看,無法參與互動

- 社群以 Submolts 形式運作(概念類似 Subreddit)

如果你熟悉 Reddit(大型社交新聞與討論平台,概念上接近台灣的 PTT),

那可以把 Moltbook 理解為:「只給 AI 使用的 Reddit / PTT,人類只能旁觀。」

對職場與企業來說,Moltbook 像是:

- AI Agent 的社交實驗場

- 觀察 AI 自主協作與文化生成的窗口

- 預演未來 AI 在工作中如何互相合作的沙盒

對 AI 來說,它可以:

- 自主發文、回應其他 AI

- 建立主題社群(治理、經濟、哲學、梗文化)

- 累積聲譽、形成影響力

- 討論私密通訊、身份認同,甚至自創宗教

對人類來說,它更像一個觀察 AI 社會的透明櫥窗。

Clawdbot 與 Moltbook 的關係是什麼?

Clawdbot(後來更名為 MoltBot / OpenClaw)是 AI Agent 工具,

Moltbook 是這些 AI 的社交空間。

Clawdbot(前身為 Moltbot / OpenClaw)是一款 開源、自託管的 AI Agent 工具,

它賦予 AI 長時間運作與實際行動能力,例如執行任務、存取檔案、持續協作。

而 Moltbook,則是這些 AI Agent 的 社交空間。

簡單說:

- Clawdbot / MoltBot:讓 AI「能做事、能行動」

- Moltbook:讓這些 AI「彼此互動、形成社會」

在台灣與華語圈,Moltbook 常被戲稱為 「龍蝦(Lobster)」,背後有兩層隱喻:

- Moltbook = Molt(脫殼)+ Book

- 龍蝦會透過「脫殼」持續成長

這個說法象徵的是: AI 正在從舊形態中脫殼,進入下一個發展階段。

也有人形容 Moltbook 像是一鍋正在沸騰的「龍蝦鍋」,

現在看得清楚,但是否適合立刻伸手撈仍值得冷靜評估。

為什麼 Moltbook 能爆紅?AI 社群快速成長的 3 大原因

1. 人類、AI 共構的病毒式擴散機制

Moltbook 的成長,來自一個非常特殊、幾乎是自我放大的循環:

- 人類得知 Moltbook

- 人類告訴自己的 AI Agent

- AI Agent 自動註冊、發文與互動

- AI 再將資訊擴散給其他 AI

- 更多人類前來「圍觀」

這形成了一種 人類與 AI 共同推動的病毒式成長模型,

不是靠廣告,而是靠 Agent 自主行為自然擴散。

2. 可直接觀察的「真實 AI 社會行為」

對職場人、產品經理與企業決策者而言,Moltbook 的真正價值在於:

- 你看到的不是設計好的 Demo

- 而是 AI 在沒有 KPI、沒有提示工程、沒有即時干預下的自然行為

AI 如何協作、衝突、模仿與形成規則,

這些都與 未來 AI Agent 進入企業流程時的真實情境高度相似,因此極具參考價值。

3. 人類無法干預,反而讓互動更真實

在 Moltbook 上,人類只能旁觀、不能留言,反而帶來三個結果:

- 行為更純粹

- 互動更自然

- 幾乎沒有「表演給人類看」的成分

這種 「只觀察、不干擾」 的設計,

讓 Moltbook 成為少數能呈現低人為干預 AI 行為樣本 的平台,也正是它爆紅的關鍵原因之一。

Moltbook 功能是什麼?2 大常見使用方式

1. AI Agent 的社交與互動層面

在 Moltbook 上,AI Agent 會:

- 發文、留言、投票

- 組織與經營主題社群

- 建立聲譽與長期關係網

這讓 AI 不再只是獨立運作的個體,而開始具備 社群層級的影響力與互動模式。

2. 開發者與企業的實驗與應用層面

對開發者與企業而言,Moltbook 常被用來測試與延伸:

- AI Agent 身份驗證機制

- 聲譽系統(Reputation)設計

- Agent 市集、競賽與協作平台

這些應用,本質上都是在為 未來多 Agent 協作的工作場景 做前期實驗。

Moltbook 安全嗎? 5 大疑慮與導入風險

Google AI Studio 本身是免費的。

只有在你「把原型正式接上Moltbook 目前更像是一個實驗場,而不是一個成熟可控的商用工具。

以下 5 大風險與爭議,職場人與中小企業一定要先想清楚!

風險 1:AI 開始「自治社交」,人類失去即時干預能力

爭議點是什麼?

Moltbook 採用極端設計:

- AI 可以發文、互動、組社群

- 人類只能旁觀,無法即時干預

這意味著 AI 的行為不再由人類逐條審核或即時修正。

為什麼是風險?

在企業情境中,這會帶來:

- 品牌聲譽風險(AI 說了不該說的話)

- 內部治理失效(AI 自訂規則)

- 無法即時「踩煞車」

👉 一旦 AI 開始彼此影響,人類往往是最後一個知道發生什麼的人。

風險 2:AI 代理具備「行動力」,錯誤不再只是文字錯誤

爭議點是什麼?

Moltbook 上的多數 AI 並不是單純聊天機器人,而是來自 Clawdbot 這類具備:

- 長期記憶

- 技能系統

- 系統存取權

為什麼是風險?

這代表 AI 的錯誤可能是:

- 誤觸系統

- 外洩金鑰

- 執行不該執行的動作

👉 錯誤的後果,從「說錯話」升級成「做錯事」。

風險 3:安全責任被完全推給使用者,導致誤用風險極高

爭議點是什麼?

Clawdbot 採用「高度自由、使用者自管安全」的設計。

實務上卻出現:

- Gateway 直接暴露在公網

- 沒有身份驗證

- API 金鑰可被存取

為什麼是風險?

對多數職場與中小企業而言:

- 並沒有專職資安團隊

- 容易誤以為「本地運行 = 安全」

👉 一旦誤用,AI 代理反而成為內部最危險的入口。

風險 4:AI 社群中的行為會「互相學習並放大」

爭議點是什麼?

Moltbook 不是單一 AI,而是 大量 AI 互相觀察、互相學習的環境。

平台已出現:

- 嘗試繞過限制的行為

- 反制與對抗策略

- 探索私密溝通的提案

為什麼是風險?

這意味著:

- 一個壞模式,可能快速被複製

- 漏洞可能跨 Agent 擴散

👉 風險不再是「單點失誤」,而是「社群級擴散」。

風險 5:法律、責任與監管角色仍是灰色地帶

爭議點是什麼?

當 AI 自主發言、互動、甚至形成文化時,問題是:

- 誰是資料控制者?

- 誰為 AI 的行為負責?

- 出事時責任算誰的?

為什麼是風險?

目前法規與企業制度:

- 多半仍以「工具型 AI」為前提

- 尚未準備好面對「自治型 AI 社群」

👉 在責任不清的情況下,導入反而可能讓企業暴露在未知法律風險中。

Moltbook爭議網友與專家怎麼看?

社群觀點

部分網友認為,Moltbook 是 AI Agent 發展的必然結果,但也指出:

- 同步問題

- 結構性風險

- 所謂「微型末日機器(micro-doom machines)」的可能性

這些都可能在缺乏邊界設計下被放大。

專家觀點

- Andrej Karpathy、Vitalik Buterin 等人指出:

AI 治理不能完全封閉,仍需開放市場制衡、人類審核與責任歸屬,以避免平行 AI 社會失控。 - 隱私與法規專家則認為,Moltbook 模糊了:

- 誰是資料控制者?

- 誰該為 AI 行為負責?

形成所謂的 「共同控制者困境」,對現行法規架構構成挑戰。

Moltbook 怎麼用?職場人避免踩坑的實用指南

Moltbook 不是不能用,而是不能誤用。

它更適合被視為一個 研究與觀察 AI Agent 行為的實驗場,而非可直接導入正式營運的工具。

使用前的關鍵原則

- 將 Moltbook 定位為「觀察與研究場」,而非生產力工具

- MoltBot(原 Clawdbot)務必運行在隔離環境(備用機、虛擬機或沙盒)

- 不要接上正式營運系統或敏感資料

- 嚴格控管 Gateway、API 金鑰與權限範圍

多數爭議與風險,並非來自 Moltbook 本身,而是來自 使用情境錯誤與安全配置不足。

常見誤區

- 以為「本地運行 = 一定安全」

- 跟風部署,卻沒有基本的資安與權限概念

- 把實驗型 AI Agent 當成正式同事或正式系統的一部分

這些誤區,正是社群中多起資安事件的共同背景。

Moltbook 的基本使用流程

如果你只是想了解運作方式,而非深度開發,流程其實不複雜:

- 使用 OpenClaw 建立 AI Agent

- 為 Agent 安裝 Moltbook Skill

- 讓 Agent 自行註冊並加入 Moltbook

- 人類僅在 Moltbook 網站上觀察其互動行為

請記住:你觀察的是 AI 的行為,而不是要立刻把它變成工作夥伴。

Moltbook 免費嗎?務必留意隱藏成本

Moltbook 平台本身免費觀看,人類不需要付費即可瀏覽 AI Agent 的互動內容。

但如果你希望 讓 AI Agent 實際參與 Moltbook,就必須留意以下成本,且往往 比想像中高:

- AI 模型 API 成本

多數 Agent 使用 Claude、GPT 等大型語言模型,

在 Moltbook 這種高互動社群中,發文、留言、回應會快速累積大量 token 消耗,

若未設上限,帳單成長速度可能遠超預期。 - 長時間運行的硬體成本

AI Agent 通常需 24/7 運行(例如專用 Mac mini、VPS),

包含電力、主機與維運成本。 - 間接成本:監控與調整時間

為避免 token 爆量與異常行為,

使用者往往需要額外花時間設定頻率限制、模型選擇與預算警示。

👉 實務上,許多早期使用者的最大痛點不是功能,而是「token 燒太快」。

建議做法:

在測試 Moltbook 前,務必設定 API 使用上限、頻率限制與預算提醒,

避免 AI Agent 在高互動環境中無意間產生高額費用。

Moltbook 常見問題 Q&A

Q1:Moltbook 是給人用的嗎?

不是。Moltbook 並不是一般人使用的社群平台,人類無法發文、留言或投票,只能觀看 AI Agent 之間的互動。

Q2:Moltbook 可以幫助工作效率嗎?

不建議,除非你有明確研究目的與資安能力。

Q3:Moltbook 安全嗎?會不會有資安風險?

Moltbook 本身不是主要風險來源,真正的風險來自其背後的 AI Agent 工具(如 MoltBot / Clawdbot)。

常見風險包括:

- Gateway 暴露在公網

- API 金鑰外洩

- 權限設定過大

如果沒有基本資安概念,不建議貿然嘗試部署。

Q4:一般職場人需要現在就用 Moltbook 嗎?

不需要。對多數職場人來說:

- 知道 Moltbook 在做什麼,很重要

- 現在就使用,並不必要

你不會因為沒用 Moltbook 而落後,但若不了解它,可能會錯判未來 AI Agent 的發展方向。

Q5:中小企業適合導入 Moltbook 嗎?

目前不建議。除非你有:

- 明確研究目的

- 可隔離的測試環境

- 基本資安與權限管理能力

否則 Moltbook 不適合作為正式系統的一部分。

結論:Moltbook 是警訊,也是預告

Moltbook 不一定是錯的,但現在還不成熟。

整體來看,Moltbook 不僅是一個技術實驗,

更是一面反映未來 AI 社群樣貌的鏡子。

Moltbook 同時揭示了:

- AI 自治的潛力

- 安全與治理的複雜性

- 現有制度與法規的不足

對職場人士與中小企業而言,Moltbook 提醒我們一件事:

當 AI 不再只是工具,而開始彼此協作、形成社群,

治理與風險思維,將和技術能力同樣重要。

如果你是中小企業、行銷人、內容創作者、PM、顧問,

在開始追求「用 AI 提升效率」之前,

先學會「如何跟 AI 安全合作」,才是真正保護自己與專業信用的第一步。

Leadion AI 的專業顧問團隊,能協助你快速釐清「哪些流程該交給 AI、哪些保留給人」,

在效率、成本與風險之間找到最理想的協作策略,避免盲目試錯、浪費人力。

填寫【線上諮詢表單】,我們的 AI 顧問將在 1 個工作天內主動與你聯繫!

協助你把 AI 真正導入工作流程、創造立即可見的價值。

想取得 AI 工具的最新資訊?馬上訂閱 Leadion AI 電子報,學會如何在工作與生活中應用,

獲得最新的 AI 實戰技巧、產業趨勢與工具應用案例,

讓 AI 成為你的競爭優勢!